Justus Piater © Thomas Steinlechner

von Simon Schöpf

Lesezeit: ca. 7 Minuten

Das Ende der Menschheit: Künstliche Intelligenz und Roboter versuchen die letzten Menschen zu vernichten! Dieses Thema wurde mittlerweile in unzähligen Filmen, Serien und Büchern beschrieben. Aber wie weit ist künstliche Intelligenz (KI; engl. Artificial Intelligence AI) im Jahr 2022 und wie weit ist die „Robokalypse“ entfernt? Wir haben uns mit Univ.-Prof. Justus Piater getroffen, um mehr über die KI-Forschung zu erfahren. Gleich vorneweg: Das mit der Apokalypse könnte noch etwas dauern, aber das heißt nicht, dass KIs komplett ungefährlich sind.

Roboter haben keine Ahnung von Physik

Justus Piater forscht an künstlicher Intelligenz für Roboter. Das Ziel ist es, diese mit hinreichend Verständnis auszustatten, damit sie mit einer unstrukturierten Umgebung sinnvoll interagieren können. Moderne Industrieroboter führen perfekt die Anweisungen aus, die ihnen ein Mensch vorgibt, verstehen tun sie aber überhaupt nichts.

Im gleichen Bereich finden sich auch die beeindruckenden Videos von Boston Dynamics, die Roboter mittlerweile sogar einen Parcours laufen lassen – jedoch nur „gescripted“, also „vorprogrammiert“. Sie führen nur vorgegebene Pfade aus, verstehen diese jedoch nicht. Es werden nur Eingabedaten auf Ausgabedaten abgebildet, was bedeutet, dass es so gut wie keine Repräsentation gibt, die z. B. physikalische Gesetzte nachbildet.

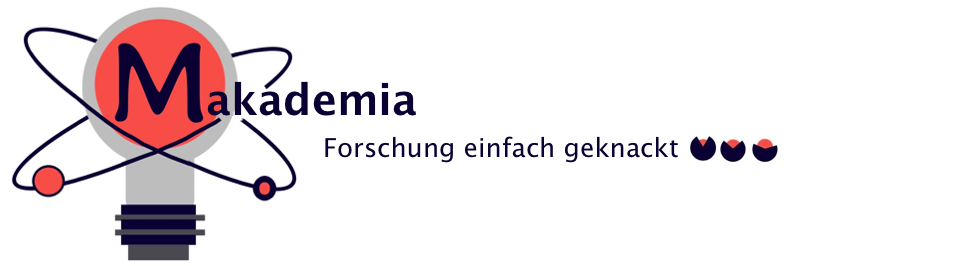

Roboter beim Lernen von Physik ©Samuel Hinterholzer

Als pragmatisches Beispiel: Maschinelle Lernsysteme haben keine Ahnung von Physik. Ein Roboter, der ausschließlich mit maschinellem Lernen arbeitet, muss lernen, dass ein Tableau gerade gehalten werden muss, damit nichts runterfällt, oder wie Dinge übereinandergestapelt werden müssen, damit sie nicht umfallen. Für uns Menschen ist das intuitiv – wir lernen das als Kind und müssen nicht bei jedem Tableau neu erlernen – eine Maschine jedoch muss das Verhalten immer wieder von neuem erwerben.

„Selbst an so einfachen Sachen scheitert maschinelles Lernen heutzutage noch“, erklärt uns der Wissenschaftler.

Ähnliches gilt für gewisse Computerspiele. Der YouTuber „Yosh“ zeigt in einem Video, wie seine entwickelte KI das Fahren auf einer Rennstrecke lernte. Justus Piater dazu: „Wenn wir uns ins Auto setzen oder ein Modellauto lenken, dann wissen wir, wo die Straße ist und dass man drauf bleiben muss und wir wissen auch, dass man, wenn man zu schnell in eine Kurve fährt, rausfliegt. Die Maschine weiß das alles nicht. Sie hat keine Konzepte von Fliehkraft und Anstoßen und noch nicht mal von Richtung.“

Die Maschine hat nur die Pixel, sie hat keine „Ahnung“ was ein Auto oder eine Straße ist. Bemerkenswert dabei ist, wie effektiv diese Systeme dies lernen können. Das benötigt jedoch sehr viele Trainingsdaten, im Vergleich zu einem Menschen.

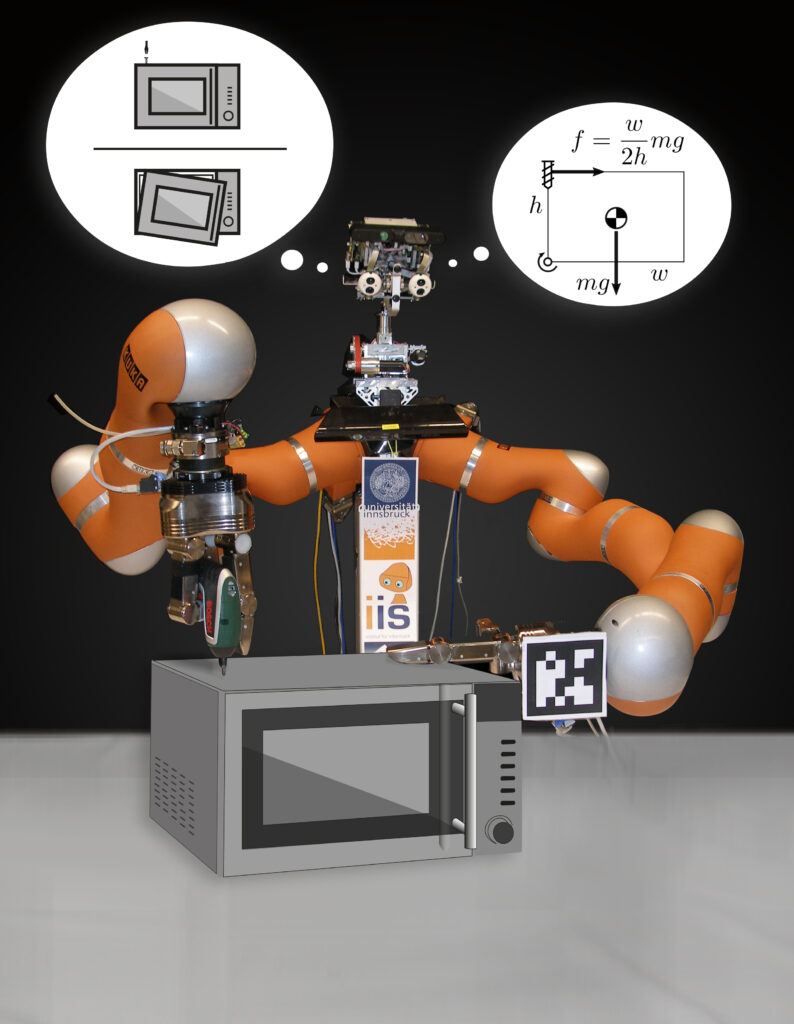

Roboter beim Handeln eines Gegenstandes ©Sebastian Stabinger

Alexa, räum mir die Küche auf!

Ein Roboter bräuchte das Konzept von Objekten, um z. B. einen Geschirrspüler einzuräumen und diese müssen noch explizit einprogrammiert werden. Das Problem ist: Wie kann die reale Welt (Objekte und deren Eigenschaften) auf diese einprogrammierten Konzepte abgebildet werden? Momentan wird dieses Problem umgangen, indem die KI die Rohdaten von Pixeln, also Bildern, lernt. Daraus resultiert aber das nächste Problem: Der Roboter kann dann eine Küche sehr gut aufräumen, scheitert aber an einer anderen Küche und die Programmierer*innen müssen von vorne anfangen.

Das Problem der internen Repräsentation wird auf verschiedene Arten angegangen. Manche Forscher*innen versuchen Physiksimulatoren einzubauen. Hierbei stößt man auf das Problem, Simulation und Realität in Übereinstimmung zu bringen. Ein sehr vielversprechendes Prinzip sieht laut Piater folgendermaßen aus:

„Man kann Systeme so aufsetzen, dass sie aus all den Pixeln und den Aktionen, die sie daraufhin ausführen, eine möglichst kompakte Repräsentation lernen und dann hofft man, dass diese kompakte Repräsentation irgendwie direkt etwas mit physikalischen Objekten zu tun hat.“

Jedoch wird das vorerst nicht ausreichen, um wiederverwendbare Konzepte von Objekten zu lernen.

Mit mehr Rechenpower zu „wahrer“ künstlicher Intelligenz?

KI-Enthusiasten versprechen sich eine funktionierende KI durch die stetig steigende Rechenleistung von modernen Computern. Mit mehr Leistung und längeren/größeren Trainingssätzen könnte auf „magische“ Weise Objektrepräsentation und Intelligenz entstehen.

Justus Piater glaubt nicht an diese Aussagen:

„Die Welt ist zu komplex dafür. Einfach nur durch Beobachtungen werden wir keine tauglichen Modelle lernen können. […] Allein durch Beobachtungen ist es unmöglich, Erklärungen für das zu finden, was dort passiert. Man braucht mehr Informationen, über die beobachteten Daten hinaus, und die können aus verschiedenen Quellen kommen. Die können einem explizit kommuniziert werden, aber damit das funktioniert, brauch ich schon einmal ein internes Framework, auf dessen Basis ich kommunizieren kann. Ich muss wissen, was die Wörter bedeuten. […] Ich denke, dass eine KI aktiv mit ihrer Umgebung interagieren und Erfahrenes hinterfragen und Neues ausprobieren muss, um erklärende Modelle, die Verständnis transportieren, zu lernen.“

Die Schirme und der Regen

Das folgende Beispiel kommt aus der Wahrscheinlichkeitslehre und der Kausalitätstheorie: Ohne Interaktion können letztlich keine erklärenden, extrapolierenden Modelle gefunden werden. Das findet sich auch in der Wissenschaft. Wir meinen etwas verstanden zu haben, formulieren eine Theorie und testen diese dann. Als plakatives Beispiel dient uns der Regen: Wir beobachten, dass Menschen die Schirme aufspannen, wenn es regnet. Tun sie dies, um trocken zu bleiben? Oder spannen sie die Schirme auf, damit es regnet? Oder verursacht ein anderes Vorkommnis sowohl Regen als auch das Aufspannen der Schirme? Diese Fragen können geklärt werden, indem man Wasser auf Menschen regnen lässt und beobachtet, ob sie daraufhin die Schirme aufspannen, und indem man Menschen Schirme aufspannen lässt und beobachtet, ob es daraufhin zu regnen beginnt. Ohne weitere Informationen wie solche Experimente, physikalische Modelle oder kulturelles Verständnis, kann eine KI den beobachteten Zusammenhang zwischen Regen und Schirmen nicht erklären.

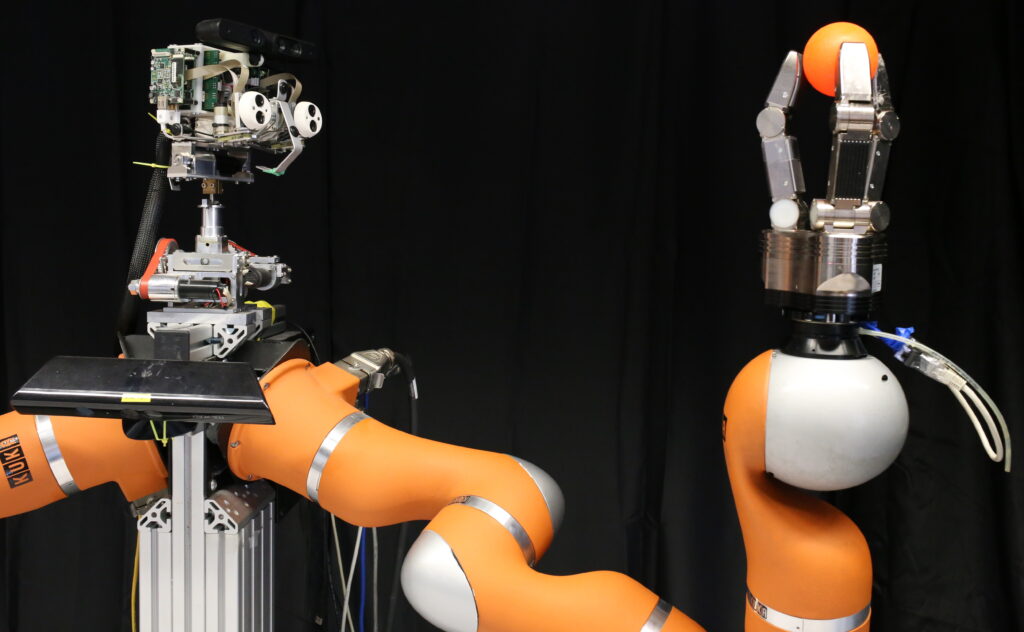

Die Kausalitätstheorie kann im Prinzip herangezogen werden, um es Robotern zu ermöglichen, erklärende Theorien selbst zu entwickeln. Hierzu könnte ein Roboter beispielsweise eine große Anzahl Theorien generieren und diese anhand von Experimenten testen. Idealerweise werden hierdurch die meisten Theorien widerlegt, und einige wenige, praxistaugliche, bleiben übrig – bis vielleicht auch diese widerlegt werden. Ähnlich wie die Newtonsche Mechanik. Diese funktioniert wunderbar auf der Erde, aber z. B. bei sehr hohen Geschwindigkeiten oder sehr kleinen bzw. sehr großen Objekten fängt diese an zu versagen. Die Newtonsche Mechanik wurde nicht verfeinert, sondern durch die Relativitätstheorie und die Quantenmechanik „ersetzt“. Was aber nicht heißt, dass wir sie im Alltag nicht mehr anwenden können.

Türme bauender Roboter ©Emre Ugur

Science-Fiction und Realität

KIs werden immer besser, aber sie werden uns in nächster Zeit nicht in allen Bereichen überflügeln, glaubt Justus Piater. In einigen Bereichen haben die Maschinen uns bereits übertroffen z. B. bei der Mustererkennung oder auch bei einem Autorennspiel. Sie können Radiologen helfen Krebs frühzeitig zu erkennen und wir nutzen sie bei der Gesichtserkennung im Smartphone, in autonomen Fahrzeugen, für Empfehlungen bei YouTube/Spotify/Netflix usw.

Es sind alles von Menschen entwickelte Systeme, mit einer gewissen Zielfunktion, welche mit verschiedenen Methoden oder mehr Trainingsdaten optimiert werden können. Das System kann sich aber „by design“ nicht selbst verbessern oder eine neue Zielfunktion wählen. Sie sind großartig in Bereichen, wo ihre Trainingsdaten liegen, außerhalb dieser können sie beliebig falsch liegen.

„Radiologische Bilder analysieren ist völlig langweilig. Ich will jetzt an einem System arbeiten, das besser ist als ich und damit dann eines Tages zum Mars fliegen. Heute Kis haben keine solchen Gedanken und Ambitionen. Das ist eine qualitativ andere Tätigkeit. In diesem Sinne sind die Maschinen nicht initiativ, nicht kreativ. Sie haben nicht das Verständnis, das man braucht, um außerhalb des eigenen Erfahrungsbereichs zu extrapolieren. Dies ist jedoch ein wesentliches Merkmal allgemeiner Intelligenz“, erklärt uns der Wissenschaftler.

Jedoch sollten wir wachsam sein, was KIs bereits können und tun. Stichwort: Algorithmen in Social-Media. Wer sich mehr auf Instagrams oder Facebooks Empfehlungssystem verlässt, als auf informierten, kritischen, unabhängigen Journalismus, und sich vermehrt von den Meinungen anderer prägen lässt, hilft dabei, die sogenannte „vierte Säule der Demokratie“ zum Einsturz zu bringen. Dies hatte und hat schlussendlich zu Konsequenzen in der realen Welt geführt, wie der Einfluss auf die Wahl Donald Trumps, den Brexit, russische Kriegspropaganda und die stärkere politische Polarisierung zwischen „Links“ und „Rechts“. Mit automatisierten Systemen kann gezielt die Meinung von vielen beeinflusst werden. Ein weiteres Negativbeispiel ist der Missbrauch von Technologie in China, dessen Überwachungssystem die Visionen aus George Orwells „1984“ in den Schatten stellt.

Philosophische Fragen

Abschließend sprachen wir mit Justus Piater über seine Faszination an seinem Forschungsgebiet, wobei wir auf philosophische Fragen stießen: Wie denken Menschen? Was heißt es zu verstehen? Wie können wir „Verstehen“ nutzbar machen und formalisieren? Wir Menschen sind den Maschinen in Punkto verstehen noch meilenweit voraus, aber wie lange werden wir wohl unseren Vorsprung noch halten?

Digital Science Center:

https://www.uibk.ac.at/disc/

Computer Science, Intelligent and Interactive Systems:

https://iis.uibk.ac.at/

Justus Piater:

https://www.uibk.ac.at/newsroom/dossiers/neue_gesichter/piater.html

LinkedIn Profil:

https://www.linkedin.com/in/justus-piater/

Vorlesung auf YouTube:

https://www.youtube.com/watch?v=7P7dSOKAonM

Google Scholar:

https://scholar.google.at/citations?user=meJCYXAAAAAJ&hl=de